Autor: Richard Richter

DevOps-Ingenieur bei XALT

Künstliche Intelligenz, insbesondere generative KI, ist längst zu einem kritischen Geschäftsinstrument avanciert. Unternehmen wetteifern darum, KI zu integrieren, um die Produktivität zu steigern, sich einen Wettbewerbsvorteil zu sichern und neue Ebenen der Kosteneffizienz zu erreichen. Doch diese rasante Adaption hat eine Schattenseite: KI-Sicherheit. Jeder Mitarbeiter, der ein KI-Tool nutzt, um Notizen zusammenzufassen oder Code zu schreiben, erzeugt einen neuen, oft unsichtbaren Datenfluss. Diese Nutzung von „Schatten-KI“ (Shadow AI), gepaart mit offiziell genehmigten Tools, öffnet die Büchse der Pandora für erhebliche Sicherheitsrisiken – von massiven Datenlecks bis hin zu korrumpierten Entscheidungsprozessen.

Das Kernproblem ist nicht die KI selbst; es ist das Versäumnis, sie abzusichern. Dieser Artikel bietet IT-Managern und Geschäftsentscheidern einen klaren, umsetzbaren Rahmen für KI-Sicherheit. Wir bewegen uns weg von der Theorie hin zu einem praktischen Plan zur Risikominimierung, damit Unternehmen die Macht der KI sicher und selbstbewusst nutzen können.

Die neue Risiko-Front: Die wichtigsten Bedrohungen der KI-Sicherheit erklärt

Bevor du eine Verteidigung aufbauen kannst, musst du die Bedrohung verstehen. Im Gegensatz zur traditionellen Sicherheit, die sich auf Perimeterschutz konzentriert, muss KI-Sicherheit auch die Logik und die Daten der Modelle selbst verteidigen.

Datenlecks & Verletzung der Privatsphäre

Dies ist das unmittelbarste und häufigste Risiko. Mitarbeiter, die produktiv sein wollen, kopieren möglicherweise sensible Daten (z. B. Kundenlisten, proprietären Code, personenbezogene Mitarbeiterdaten) in öffentliche KI-Prompts. Diese Informationen können in die Trainingsdaten des Modells einfließen und potenziell in der Anfrage eines anderen Benutzers (auch außerhalb des Unternehmens) wieder auftauchen. Dies ist der direkte Weg in einen Compliance-Albtraum (DSGVO) und zum Verlust geistigen Eigentums.

Modell-Vergiftung (Model Poisoning) & Angriffe auf die KI-Logik

Neben unbeabsichtigten Datenlecks spielt auch Datenvergiftung (Data Poisoning) eine wachsende Rolle. IBM beschreibt Datenvergiftung als eine Form von Cyberangriff, bei dem Bedrohungsakteure die Trainingsdaten von KI- und ML-Modellen gezielt manipulieren oder beschädigen, um das Verhalten der Modelle zu beeinflussen.

Stell dir vor, ein Angreifer füttert ein Finanzmodell subtil mit falschen Daten, was zu verheerenden Handelsempfehlungen führt. Ähnlich funktionieren Angriffe wie „Prompt Injection“, bei denen ein versteckter Befehl in einem Dokument die KI dazu zwingt, ihre Sicherheitsprotokolle zu ignorieren und schädliche Aktionen auszuführen, wie etwa das Exfiltrieren von Nutzerdaten.

„Schatten-KI“ & ungeprüfte Tools

Deine Teams nutzen wahrscheinlich bereits KI, unabhängig davon, ob du eine Richtlinie dafür hast oder nicht. Befragungen zufolge geht nur noch etwa jedes dritte Unternehmen davon aus, dass dies nicht geschieht. Wenn sich Mitarbeiter mit ihren Geschäftskonten bei kostenlosen, ungeprüften KI-Tools anmelden, gewähren sie diesen Tools möglicherweise breiten Zugriff auf Unternehmensdaten (wie E-Mails oder Cloud-Laufwerke) ohne jegliche Sicherheitsaufsicht. Dies schafft eine massive, undokumentierte Angriffsfläche.

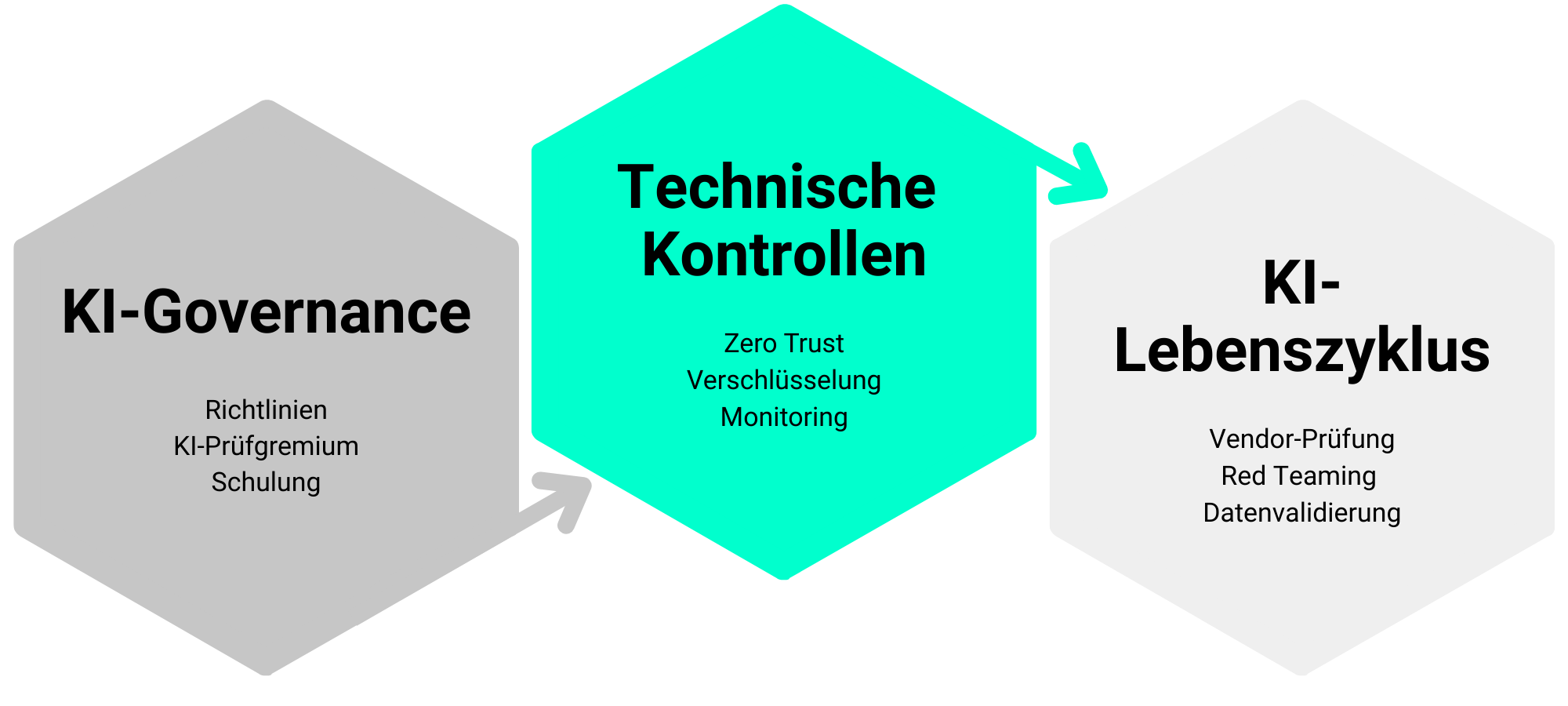

Ein 3-Säulen-Framework zur Risikominimierung für KI

Eine sichere KI-Strategie besteht nicht nur aus einem einzigen Tool; es ist ein umfassender Ansatz, der auf drei Säulen ruht.

1. Robuste KI-Governance etablieren

(Das „Warum“ und „Wer“)

- Erstelle eine klare Richtlinie: Definiere, was akzeptabel ist und was nicht. Welche Tools sind genehmigt? Welche Datenarten (z. B. „Öffentlich“, „Intern“, „Vertraulich“) dürfen mit welchen Tools verwendet werden?

- Bilde ein KI-Prüfgremium: Stelle ein funktionsübergreifendes Team zusammen (IT, Recht, Operations), um neue KI-Tools und Anwendungsfälle zu prüfen und zu genehmigen.

- Schule deine Mitarbeiter: Dein Team ist deine erste Verteidigungslinie. Trainiere sie darin, Risiken zu erkennen, die Datenklassifizierungsrichtlinien zu verstehen und KI-gesteuertes Phishing oder Deepfakes zu identifizieren.

- Nutze bewährte Frameworks: Erfinde das Rad nicht neu. Basiere deine Governance auf Industriestandards wie dem NIST AI Risk Management Framework (RMF).

2. Starke technische Kontrollen implementieren

(Das „Wie“)

- Zugriffskontrolle durchsetzen: Implementiere ein Zero Trust-Modell und das Prinzip der geringsten Rechte (Least Privilege). KI-Agenten und Benutzer sollten nur Zugriff auf das absolute Minimum an Daten haben, das für ihre Aufgabe erforderlich ist.

- Daten sichern: Verschlüssele alle sensiblen Daten, sowohl im Ruhezustand als auch bei der Übertragung. Nutze Datenanonymisierung und Maskierungstechniken, bevor Daten jemals zur Analyse an ein KI-Modell gesendet werden.

- Überwachung & Audits: Du kannst nicht sichern, was du nicht siehst. Implementiere eine kontinuierliche Überwachung, um alle KI-Abfragen zu protokollieren, Anomalien zu erkennen (z. B. ein Benutzer lädt plötzlich riesige Datensätze herunter) und die APIs zu sichern, die KI mit deinen Kernsystemen verbinden.

3. Den KI-Lebenszyklus sichern

(Das „Was“)

- Prüfe deine Anbieter: Wenn du KI von Drittanbietern nutzt, verlange Einsicht in deren Sicherheits- und Compliance-Dokumentation (z. B. SOC 2-Bericht, Richtlinien zur Datenverarbeitung).

- Teste die Modelle (oder deren Modelle): Führe bei kritischen internen oder Anbietermodellen Adversarial Testing (Red Teaming) durch. Versuche aktiv, das Modell auszutricksen, zu vergiften oder zu brechen, um Schwachstellen zu finden, bevor es ein Angreifer tut.

- Validiere deine Daten: Stelle bei internen Modellen sicher, dass deine Trainingsdaten sauber, validiert und frei von Verzerrungen (Bias) oder Manipulationen sind. Der Output deiner KI ist nur so gut wie ihr Input.

KI-Sicherheit ist kein Kostenfaktor, sondern ein Wegbereiter

Viele Führungskräfte betrachten Sicherheit als Kostenstelle. Das ist ein kritischer Fehler. Im Zeitalter der KI ist starke KI-Sicherheit das Einzige, was deinen ROI schützt. Denn:

KI-Initiativen sind darauf ausgelegt, einen Wettbewerbsvorteil zu erzielen und Kosteneffizienz zu treiben. Eine einzige Datenschutzverletzung oder ein vergiftetes KI-Modell stoppt diesen Fortschritt nicht nur, es kehrt ihn um und begräbt dein Team unter behördlichen Geldstrafen, Reputationsschäden und dem katastrophalen Verlust des Kundenvertrauens.

Bei XALT verstehen Risikominimierung als Beschleuniger für Innovation. Indem du ein sicheres Fundament baust, befähigst du deine Teams, sicher zu experimentieren, zu automatisieren und zu innovieren. Sie bewegen sich schneller als Wettbewerber, die entweder durch Risiko gelähmt oder rücksichtslos exponiert sind. Sichere KI bedeutet nicht, langsamer zu werden; es bedeutet, die Hochgeschwindigkeitstraße zu bauen, die sicherstellt, dass die wertvollsten Vermögenswerte deines Unternehmens ihr Ziel unversehrt erreichen.

Fazit: Die wichtigsten Erkenntnisse

- KI ist eine geschäftliche Notwendigkeit: Das Ignorieren von KI ist keine Option mehr, da sie ein Haupttreiber für Effizienz und Wettbewerbsvorteile ist.

- Das Risiko ist real und neu: Die Hauptrisiken – Datenlecks, Modell-Vergiftung und Schatten-KI – zielen auf die Kernlogik und Daten von KI-Systemen ab und können verheerende Folgen haben.

- Sicherheit ermöglicht Innovation: Eine proaktive Strategie für KI-Sicherheit, die auf den Säulen Governance, technische Kontrollen und Lebenszyklus-Sicherheit aufbaut, ist kein Hindernis. Sie ist das essentielle Fundament, das deinen ROI schützt und es dir ermöglicht, mit Geschwindigkeit und Zuversicht zu innovieren.

Der Weg zur Optimierung mit XALT

Dieses Framework mag komplex erscheinen, aber du musst es nicht alleine implementieren. XALT ist darauf spezialisiert, Unternehmen an der Schnittstelle von Prozessoptimierung, Atlassian-Tools und fortgeschrittener Automatisierung zu unterstützen. Wir helfen dir dabei, Governance-Richtlinien, technische Leitplanken und automatisierte Workflows zu erstellen, um deine KI-Einführung vom ersten Tag an abzusichern.

Bist du bereit, deine Workflows zu transformieren und die Kraft der KI sicher zu nutzen? Kontaktiere die Experten von XALT für ein Beratungsgespräch.